Lifefloor es una instalación inmersiva e interactiva basada en el Juego de la Vida, que es el autómata celular más conocido en simulaciones matemáticas de sistemas celulares inteligentes, creado por el matemático británico John Horton Conway en 1970. Este algoritmo es utilizado por científicos, matemáticos o economistas como un ejemplo simulado de auto organización y para el desarrollo de sistemas complejos a través de la implementación de reglas simples. Tiene el poder de una máquina de Turing; es decir, cualquier cosa que pueda ser calculada algorítmicamente puede ser calculada dentro del Juego de la Vida de Conway.

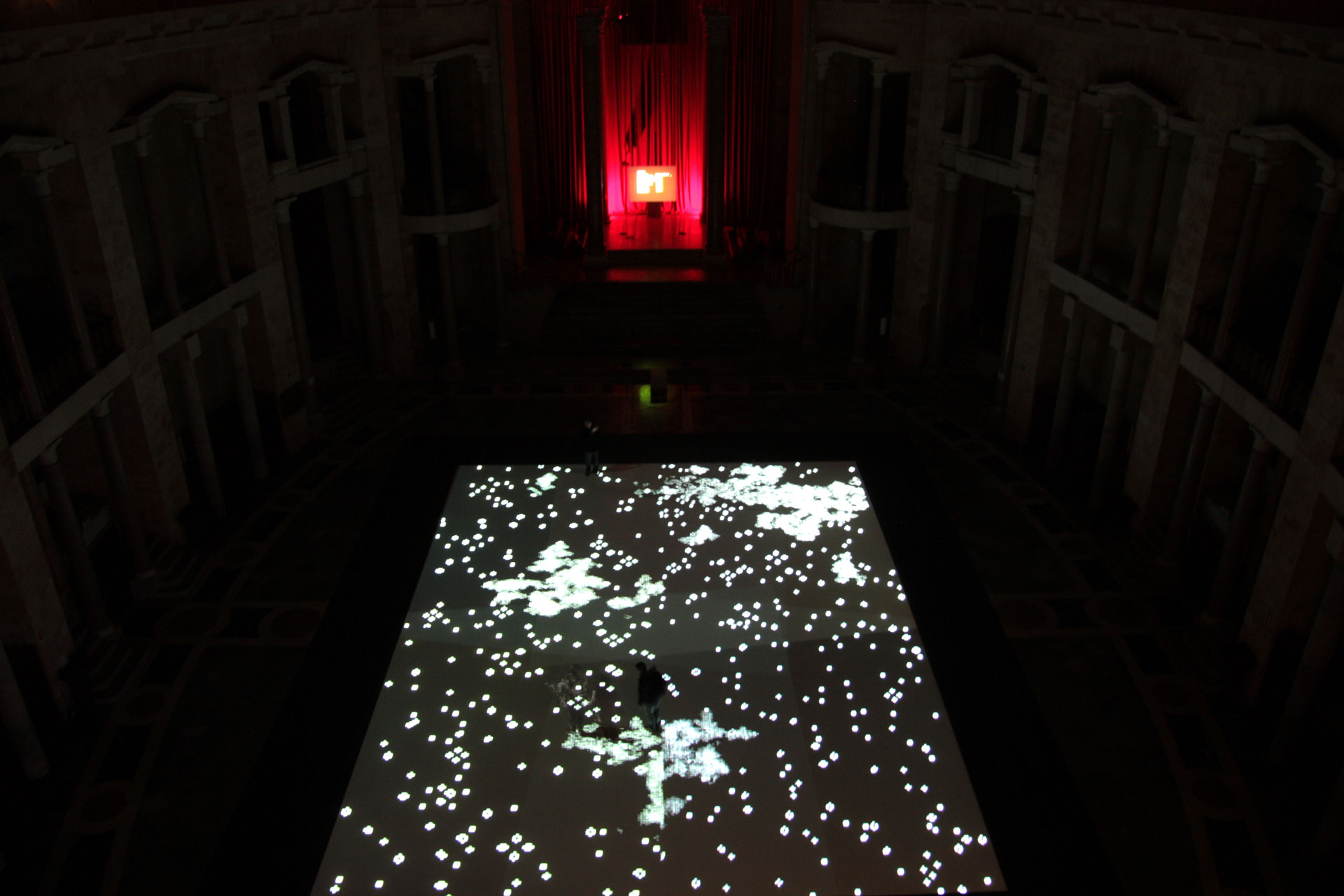

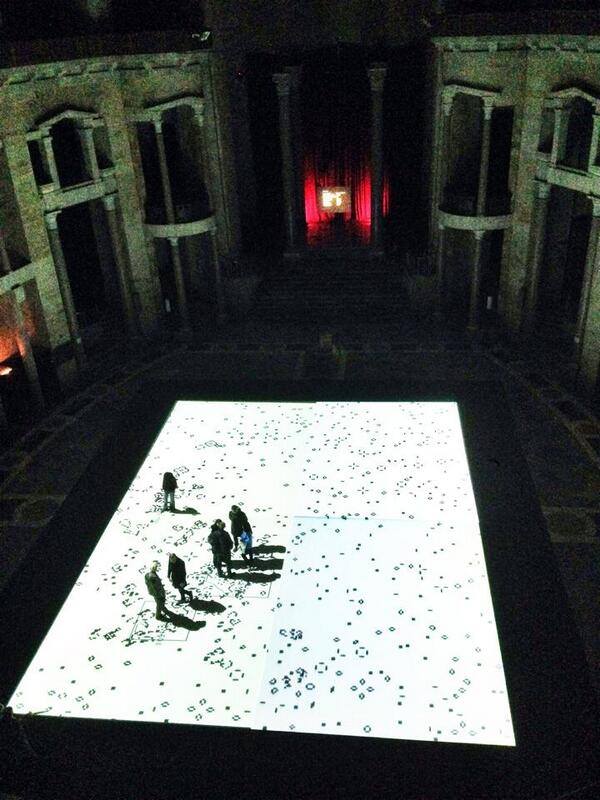

Ubicada en el contexto de una iglesia desacralizada, la pieza busca apropiarse de los mismos espacios utilizados para el rito para el cual fue creada, para realizar simbólicamente un nuevo culto: el culto a la ciencia, a las matemáticas, a las teorías técnicas y científicas en busca de la verdad empírica

IMAFY, Cairo, Egipt

Del 6.4.08 al 8.3.08

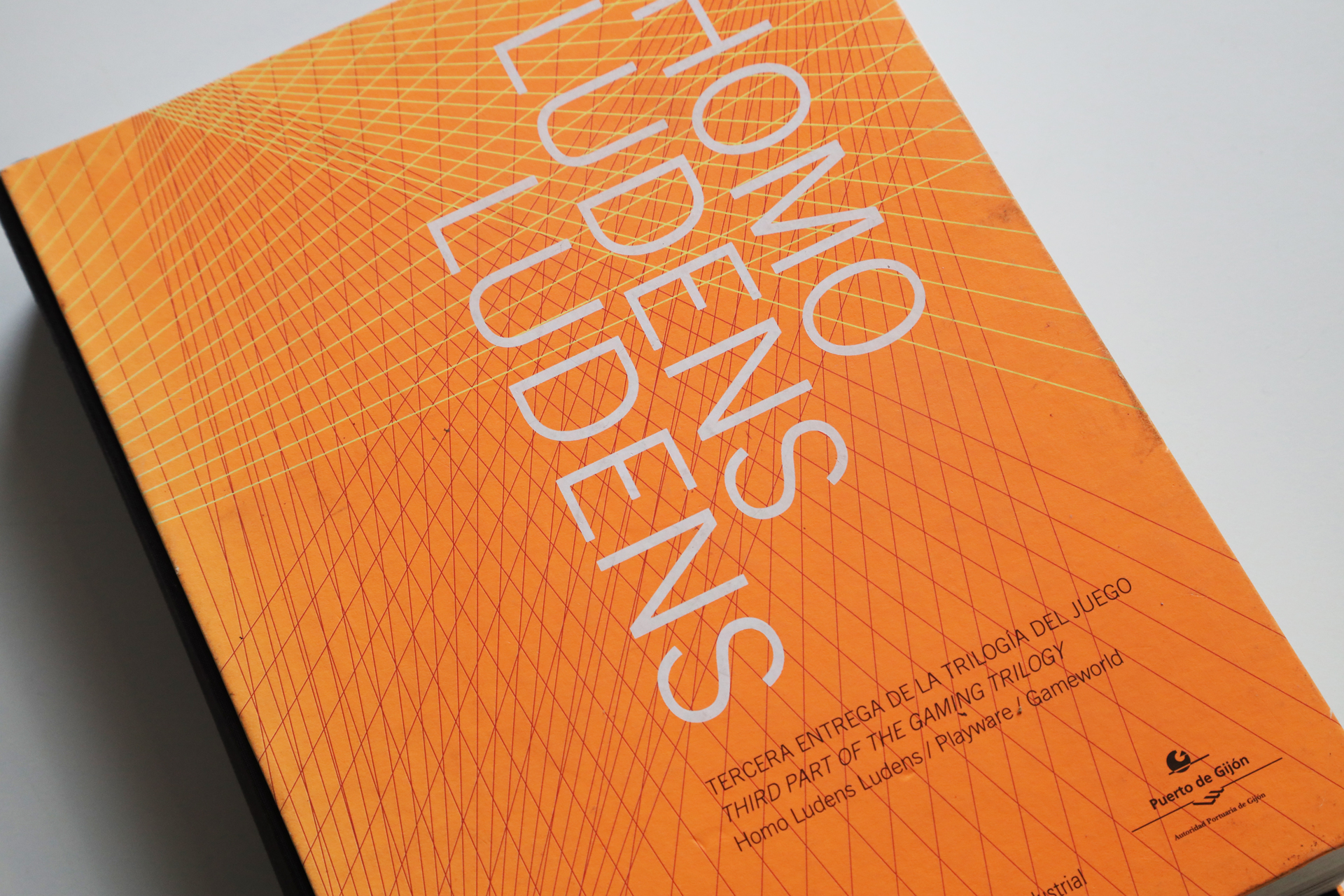

Homo ludens ludens, LABoral

Del 18.4.08 al 22.09.08

LABoral ciudad de la cultura, Gijón/Xixón, Spain

Del 13.12.14 al 7.1.15

Dossier PDF

Available for sale or exhibition

Créditos v1:

Concepto: Román Torre

Desarrollo de software e interacción: Enrrique Tomás

Producción técnica: Gustavo Valera

Credits v2:

Concepto, Interacción & software: Román Torre

Diseño de sonido: Felipe L.Navarro

Fuentes de vídeo: Sergio Redruello

Fredy Fernandez, Román Torre

(Spanish only)

Estas lineas están destinadas a satisfacer la curiosidad manifiesta de algunos de vosotros, amigos e interesados, sobre en el funcionamiento de la pieza LIFEFLOOR V1. Como «compartir es vivir», espero que esta información os ayude un poco a plantear instalaciones de este tipo, en espacios singulares y un poco complicados por cuestiones de escala.

Detalles técnicos generales de la instalación en Laboral:

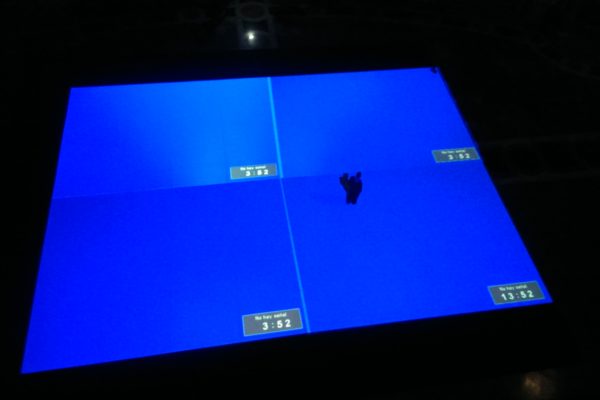

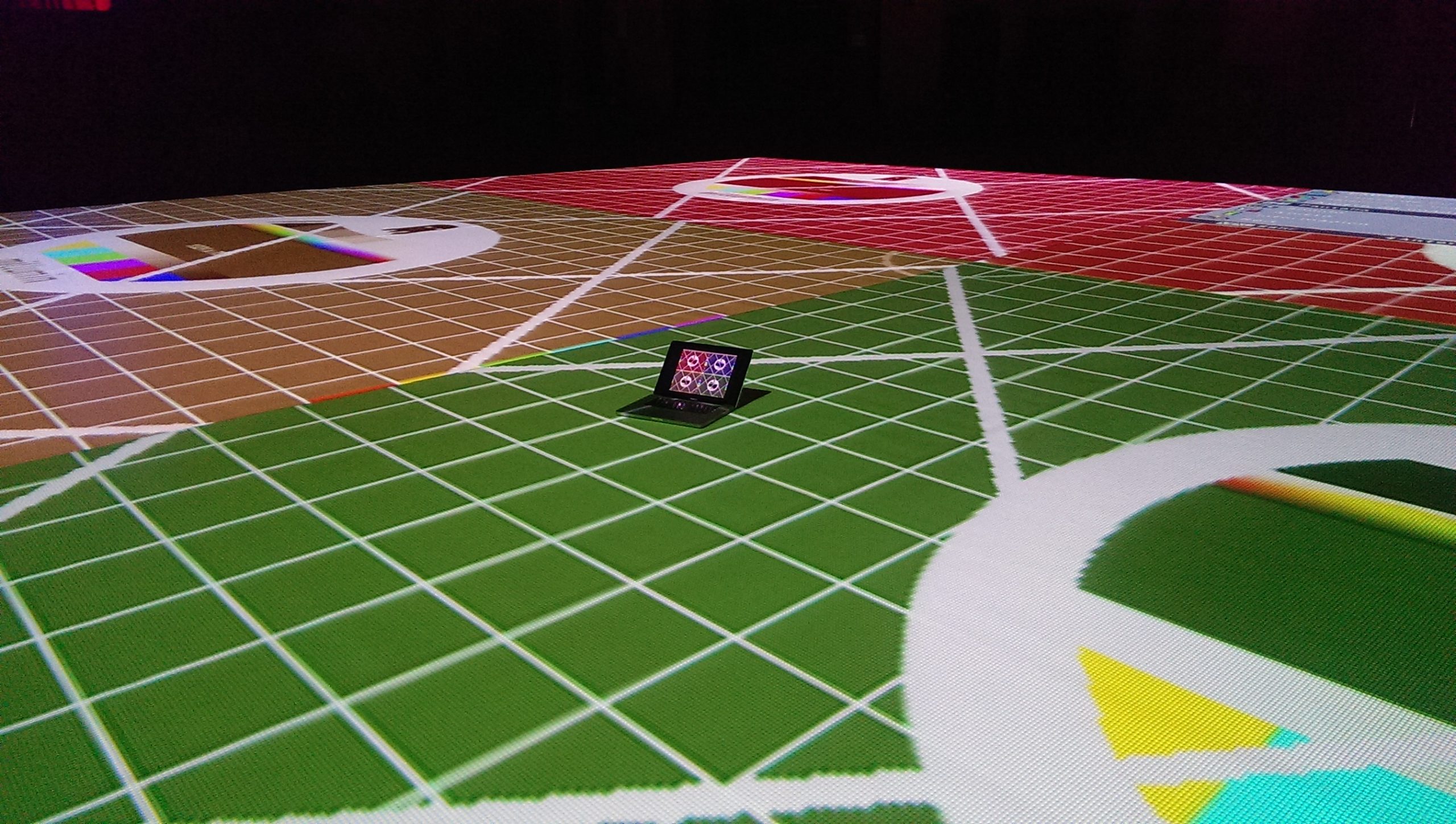

197m2 proyección en el suelo dividida en 4 proyectores Sanyo de 5.500 lumens y lente intercambiable.

1 Proyector para los datos 2500 lumens.

1 Distribuidor de señal HDMI/VGA.

1 cámara CCV B/N situada a 14m de altura. Iluminación infrarroja / 8 Flood Lights 1kw.

2 MacMini / Visuales y Sonido.

Sonido 5.1 / 5 canales independientes (SubW+4 cajas).

Conexión cableada de red para control remoto de la instalación.

197m2 de linóleo blanco, perímetro rodeado de moqueta oscura.

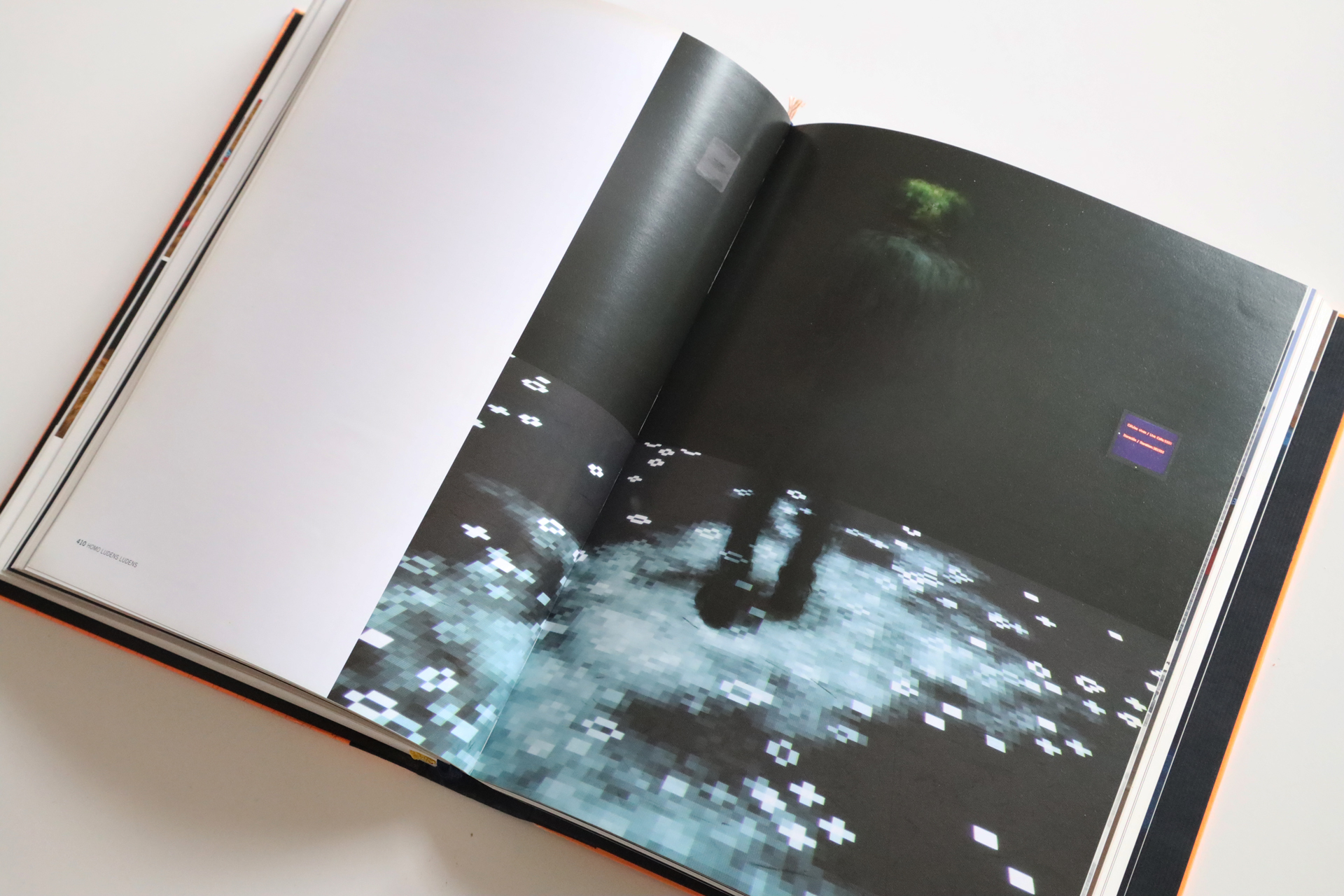

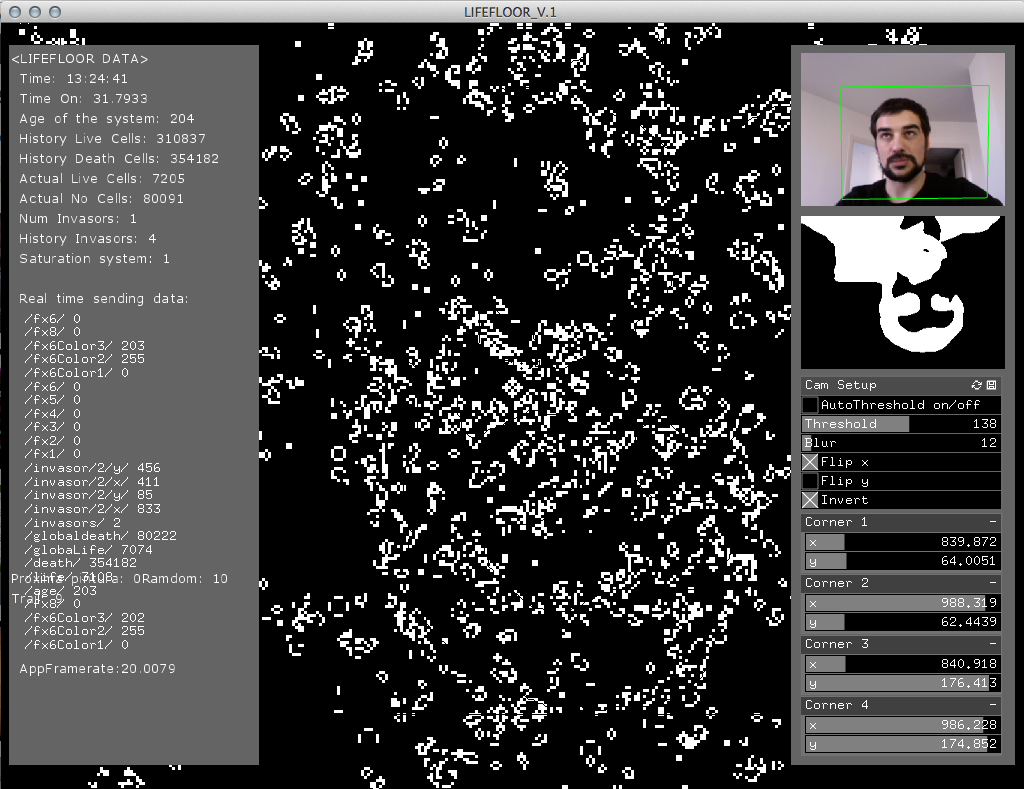

El software principal es la raíz de todos los datos de la instalación: detecta los movimientos dentro del perímetro, envía por OSC todos los datos al sonido y renderiza el algoritmo del Juego de la Vida, con todas sus modificaciones e inputs en tiempo real.

La parte visual de la instalación está desarrollada en C++ con el kit de librerías OpenFrameworks y varios de sus más conocidos Addons. Su sistema de visión funciona con la técnica llamada Background Dynamic Subtraction, la cual hace que el software compare constantemente los pixeles de la cámara-sensor en busca de posibles zonas cambiantes+pixeles oscuros.

Librerías principales: ofxCv, ofxOsc, ofxGui, ofxSyphon.

Para la detección de movimiento usamos una cámara simple de CCTV con un alto rango de visión en la oscuridad 0Lux y la posibilidad de desactivar la ganancia, todo ello junto a una lente gran angular 2.8. Hemos usado una gelatina infrarroja para filtrar la luz de ese rango y hemos iluminado el espacio convenientemente con luz difusa de ese rango, usando para ello gelatinas RGB colocadas en 8 panoramas asimétricos ( Flood Ligths ) distribuidos por el espacio. La señal es de tipo BNC, quizás la más estable y barata para conseguir grandes distancias de señal sin problema. La entrada de señal en el ordenador la conseguimos mediante una tarjeta capturadora firewire tipo Canopus AVCD-55.

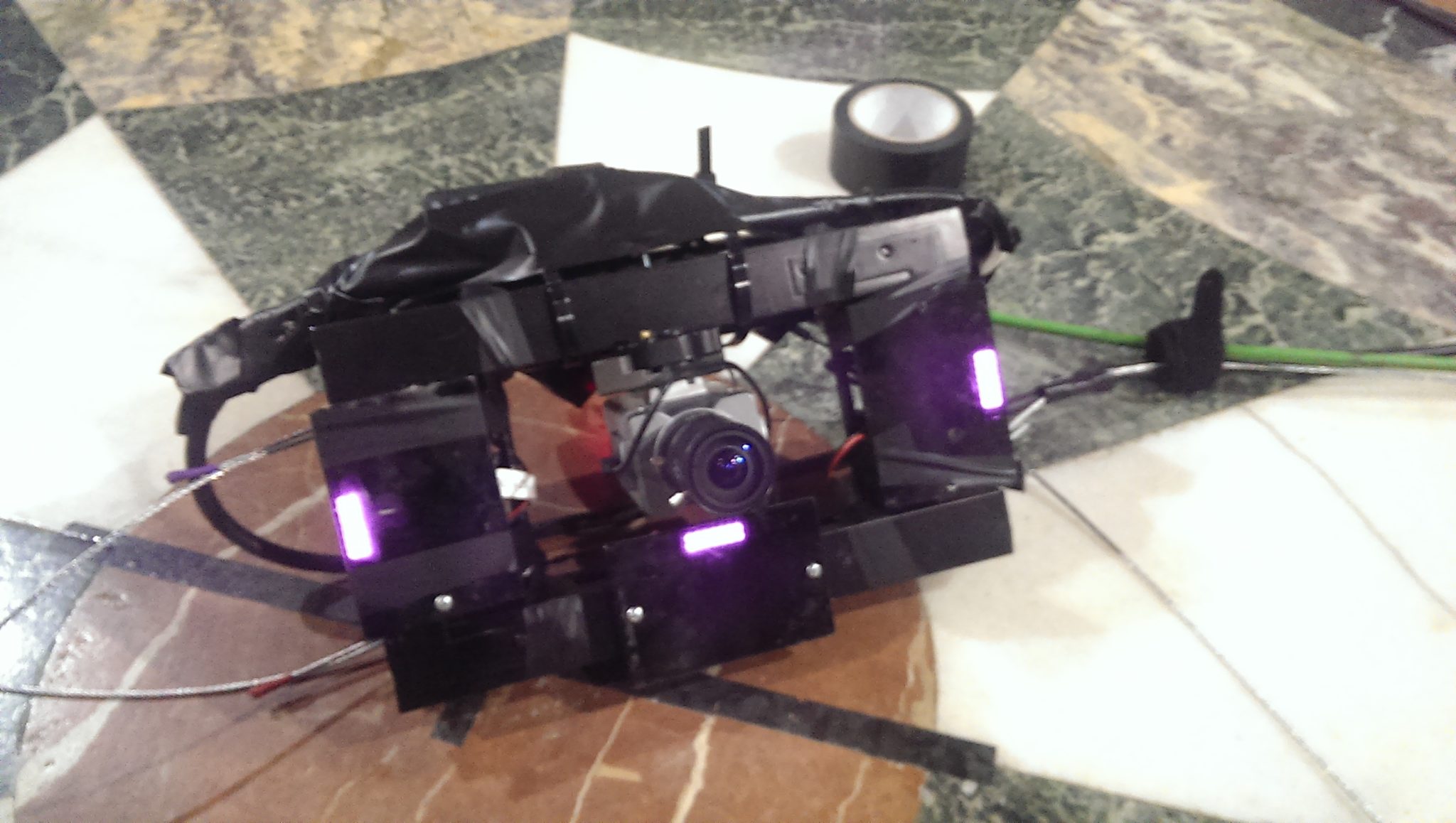

El handicap aquí vino de la mano de colocar está cámara en el centro de la instalación, a casi 14 metros de altura y con un vano inaccesible de más de 17m entre paredes donde podríamos posicionarnos para sujetar cualquier estructura. Para lograrlo nos lanzamos previo acuerdo a probar una solución peculiar pero que finalmente fue muy bien, se trata de colgar la cámara del centro mediante cable de acero tensado e ir ajustando su centro con el de la proyección. Una vez arriba y más o menos en el sitio, se ajustaría el área de detección al de proyección mediante correcciones que previamente implementé en el software. Según teníamos clara esa vía, construí en el estudio un soporte reciclando aluminio, reforzado con varilla roscada, donde instalar todos los elementos necesario de manera fácil: Cámara ( con cierre rápido ), Infrarrojos y regleta de conexión.

Para el ajuste de proyectores se ha usado la librería Syphon para así enviar el streaming de la imagen a Millumin, usado para la configuración y ajuste de la imagen en los 4 proyectores. Finalmente y debido a problemas técnicos de última hora ( fue imposible conseguir por parte de la organización el ordenador con las gráficas adecuadas ), en está ocasión nos vimos obligados a sacar la misma imagen por los 4 proyectores, usando solo en cada uno la parte correspondiente a la misma pantalla.

Para el ajuste de proyectores se ha usado la librería Syphon para así enviar el streaming de la imagen a Millumin, usado para la configuración y ajuste de la imagen en los 4 proyectores. Finalmente y debido a problemas técnicos de última hora ( fue imposible conseguir por parte de la organización el ordenador con las gráficas adecuadas ), en está ocasión nos vimos obligados a sacar la misma imagen por los 4 proyectores, usando solo en cada uno la parte correspondiente a la misma pantalla.

Igualmente no tuvimos alternativa viable y debido a estos problemas, si ganamos en velocidad de la aplicación, corriendo la misma a un fps sobrado en una máquina relativamente escasa en recursos, como es un MacMini.

En la 5ª pantalla, la que muestra los datos internos de la instalación y que está situada en el altar, hemos usado un distribuidor de señal para garantizarnos una estabilización correcta, ya que estamos usando grandes tiradas de cable Vga.

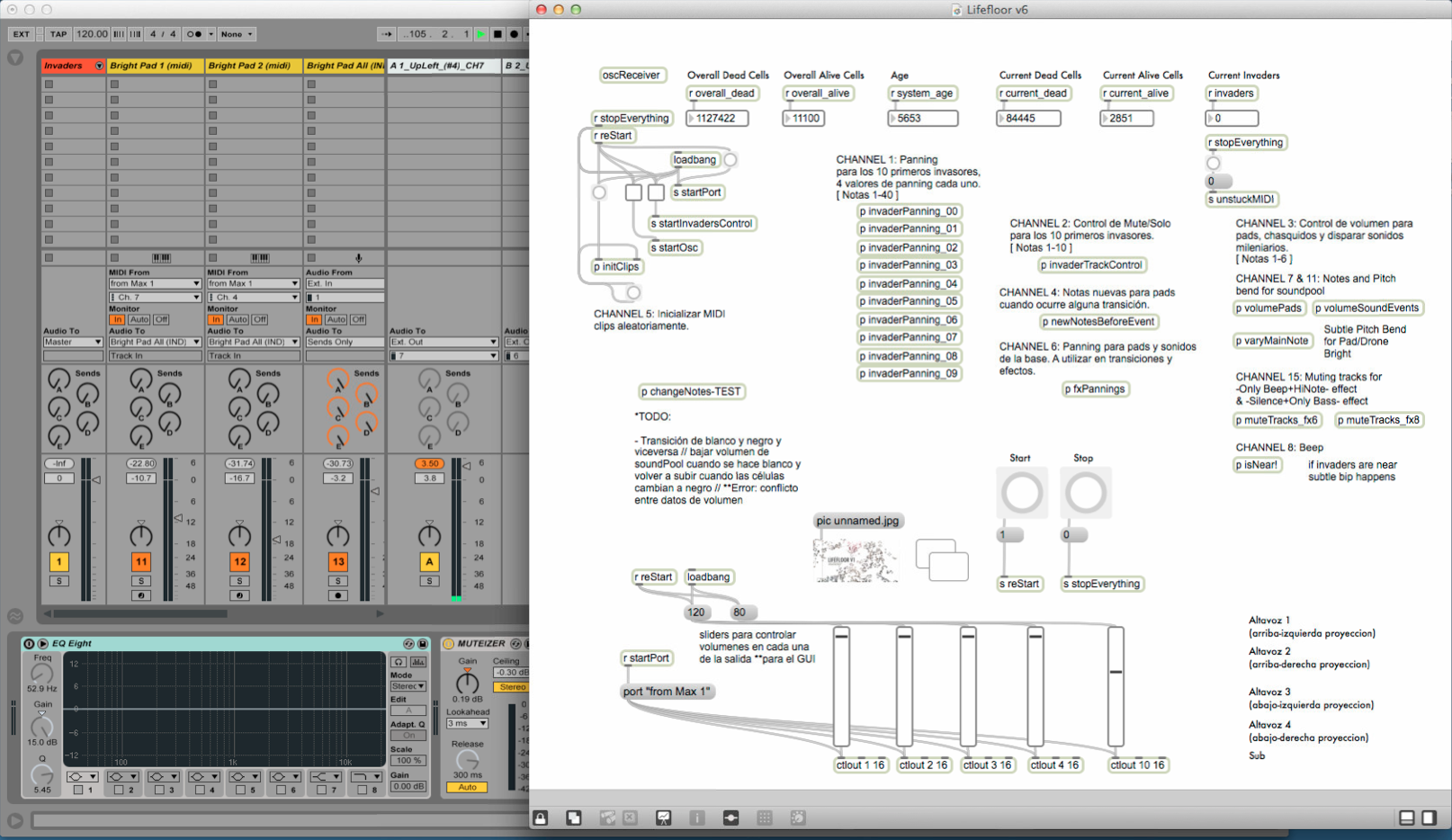

El sistema de sonido está compuesto por un subwoofer y 4 canales de audio independientes. Para dispararlo, hemos usado un ordenador dedicado y comunicado vía OSC con el principal. Este se encarga de correr una aplicación desarrollada en MaxMsp por Felipe L.Navarro, que se ocupa de interpretar los datos del sistema controlando via Midi ,una sesión de Ableton Live. Esta aplicación combina los datos recibidos de la posición y movimientos de los participantes, con los del Juego de la vida en desarrollo, usando los mismos para subir y bajar volumenes, panear entre los 5 canales independientes y disparar los sonidos correspondientes en base a las secuencias o momentos predefinidos por el sistema principal.

Síguenos

Newsletter